Si 2023 a été l’année de l’exploration des super-pouvoirs de l’IA générative, 2024 sera l’année décisive qui verra l’intelligence artificielle de plus en plus intégrée à nos activités. En première ligne : les acteurs du marketing et de la communication.

Entre la création de visuels de plus en plus convaincants ou la génération de textes de moins en moins robotiques, les progrès des technologies IA au cours des derniers mois sont aussi impressionnants qu’ils peuvent être effrayants. Alors, les robots vont-ils finalement réussir à remplacer les humains comme dans un bon Sci-Fi Movie des années 90 ? Pas si sûr.

Dans cet article, je m’attèle à débunker 5 idées reçues parmi les plus courantes sur la génération de contenus texte par l’intelligence artificielle. Et, droit de défense oblige, je demanderais ensuite son avis à ChatGPT 🤖 à la fin de l’article.

Idée reçue n°1 : l’IA va totalement remplacer les rédacteurs de contenu

Faux (enfin j’espère 🥲)

C’est de loin l’idée reçue la plus répandue et celle qui fait aussi le plus peur aux créateurs de contenu que nous sommes. Et c’est bien légitime quand on voit la qualité de certains contenus générés à l’aide de prompts bien ficelés et parfaitement optimisés. Mais aussi efficace soit-il, il manque encore à ChatGPT quelques atouts bien humains indispensables à l’écriture qu’il n’a pas encore réussi à totalement nous piquer ; comme la créativité, le style ou la personnalité. Un contenu généré par une IA reste… un contenu généré par une IA. Alors pour lui donner de l’âme et du caractère, un texte IA aura toujours besoin de l’intervention d’un humain. Ouf.

Idée reçue n°2 : le contenu généré par IA est sanctionné par Google

Faux (et c’est Google qui le dit)

Avec son armada de robots crawlers et ses algorithmes ultra-complexes, Google est-il capable oui ou non de reconnaître un contenu généré par l’IA ? Eh bien… peut-être, sûrement même, mais à priori il n’en a pas grand chose à faire ! En fait, ce qui compte pour lui, et donc ce qui va faire qu’un contenu sera mis en avant plus qu’un autre dans la SERP, c’est avant tout sa qualité. Si votre contenu travaillé à l’aide de ChatGPT est bien construit, instructif, sourcé et apporte une vraie valeur ajoutée à vos lecteurs (en bref, s’il respecte les fameux critères E.E.A.T de Google), alors il ne sera jamais sanctionné par celui-ci. Je cite : “Nous nous concentrons sur la qualité du contenu plutôt que sur la façon dont il est produit.”* Voilà qui a le mérite d’être clair !

*Source : “Conseils de la recherche Google concernant le contenu généré par IA” du Google Search Central Blog.

Idée reçue n°3 : Il y a un risque de duplicate content avec le contenu généré par IA

Là encore, c’est faux.

Mais l’interrogation est légitime. En effet, qu’est-ce qui me prouve que mon article généré par ChatGPT sur un sujet donné ne sera pas identique à un autre article IA sur le même sujet ? Eh bien c’est tout le concept de l’IA générative qu’il faut garder en tête. À chaque nouvelle requête, même si elles sont identiques, ou similaires, l’IA va produire un contenu unique qui aura été généré expressément pour vous à un instant T. Il ne devrait donc théoriquement pas y avoir de souci de duplicate content avec l’IA.

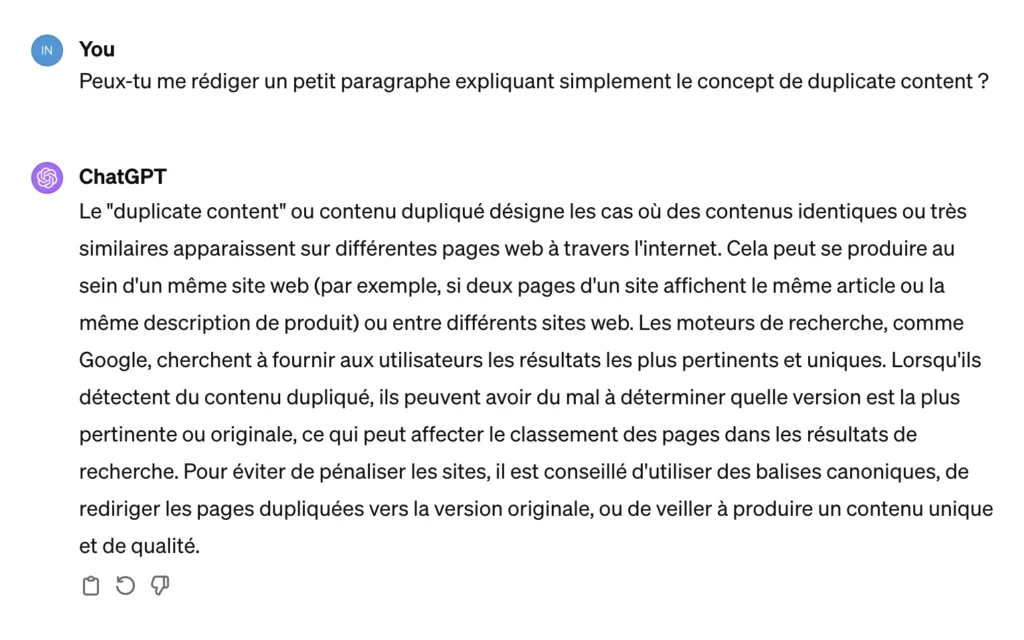

Pour vous en convaincre, j’ai réalisé un petit test avec ChatGPT. Je lui ai demandé de me rédiger un paragraphe sur le duplicate content à 30 secondes d’intervalle et sur des chats différents. J’ai utilisé le même prompt et voici ses réponses :

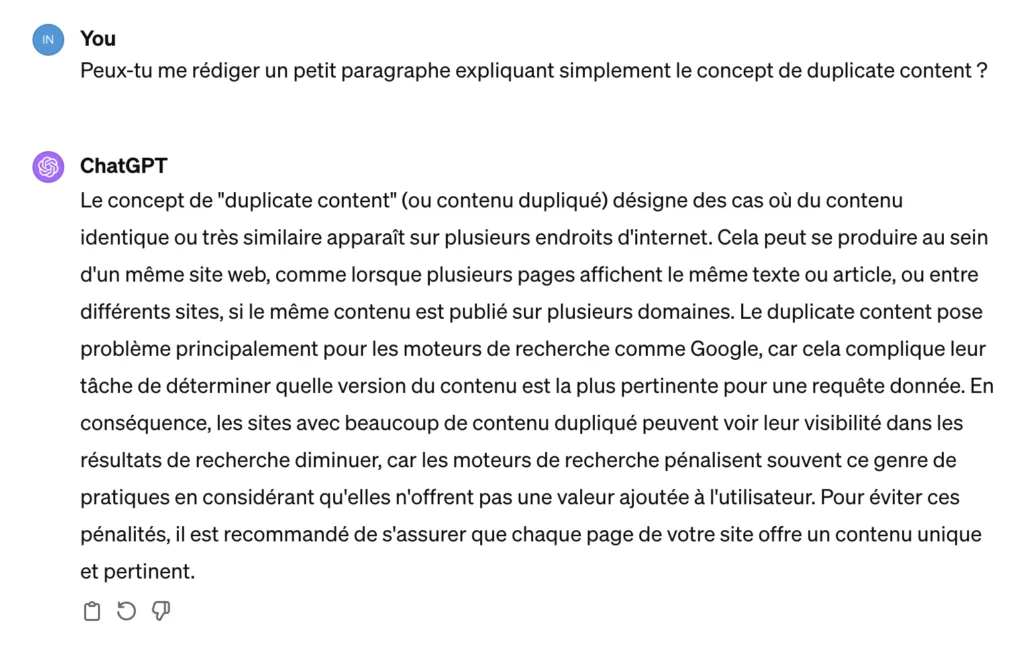

Alors, même si les idées développées dans les deux textes se ressemblent forcément, on n’obtient pas des textes similaires. Pour aller plus loin j’ai voulu les comparer en utilisant un outil capable de détecter les contenus dupliqués. Voici le résultat :

Avec un taux de similarité de 35% seulement, les deux textes ne seront pas considérés par Google comme des contenus dupliqués. Pour ça, il aurait fallu qu’ils dépassent un taux de 70%. Plutôt pas mal !

Idée reçue n°4 : l’IA fait des erreurs et le contenu produit doit toujours être vérifié

Ça par contre, c’est vrai.

L’IA peut faire des erreurs tout simplement car ses modèles se basent sur des données préexistantes jusqu’à un certain point dans le temps (avril 2023 dans le cas de ChatGPT). Il arrive aussi que les IA n’interprètent pas bien les informations ou les synthétisent mal. En plus, les IA génératives n’ont actuellement pas la capacité de vérifier ou d’actualiser leurs connaissances en temps réel.

Alors pour se dédouaner de ce (petit) souci d’inexactitude, le chatbot d’OpenAI annonce même la couleur dans un (petit) disclaimer situé sous le champ de message : “ChatGPT can make mistakes. Consider checking important information.” Vous l’aurez donc compris, l’IA peut faire des erreurs et il s’agira de toujours vérifier les informations qu’elle vous donne.

💡 À savoir que Google vient tout juste de mettre en place sur son modèle d’IA générative Gemini un système de vérification des réponses. Il suffira de cliquer sur un bouton pour lancer une recherche Google qui ira trouver des contenus semblables ou différents des réponses de Gemini pour assurer l’utilisateur de leur exactitude (ou non).

Idée reçue n°5 : l’IA pose un problème de droits d’auteur et de propriété intellectuelle

Vrai et c’est problématique…

Oui, c’est indéniable, l’IA générative pose de sérieux problèmes de droits d’auteur. Ce n’est pas pour rien que le New York Times (rien que ça) a pris des mesures juridiques contre OpenAI et Microsoft, les accusant d’utiliser des millions d’articles du journal sans permission pour entraîner leurs modèles d’intelligence artificielle générative, tels que ChatGPT et Copilot.

Depuis, le journal américain a mis à jour ses conditions de service pour interdire explicitement l’utilisation de son contenu sans consentement préalable écrit. Une action qui met en lumière les tensions croissantes entre les créateurs de contenu et les développeurs d’IA générative. Tensions qui ne sont pas prêtes de s’atténuer avec l’arrivée prochaine annoncée en Europe de la nouvelle expérience de recherche intégrant l’IA : Google SGE. Affaire à suivre donc !

Et enfin, pour finir j’ai demandé au principal concerné (ChatGPT) s’il pouvait me donner 5 idées reçues sur lui-même, et je vous laisse avec ses réponses :

Le prompt :

J’aimerais écrire un article de blog sur l’intelligence artificielle intitulé : « Vrai ou Faux, 5 idées reçues sur l’IA appliquée à la création de contenu ». L’idée est de débunker les idées reçues sur l’utilisation de l’IA pour la rédaction de contenu. Quelles sont selon toi ces 5 idées reçues ?

ChatGPT :

Voici cinq idées reçues courantes sur l’intelligence artificielle appliquée à la création de contenu, accompagnées d’une brève explication pour chaque point qui pourrait servir de base à votre article de blog :

| 1. L’IA va remplacer tous les rédacteurs et créateurs de contenu Vrai ou Faux ? Faux. Explication : Bien que l’IA puisse générer du contenu à une vitesse et une échelle inégalées, elle ne peut pas remplacer l’expertise humaine, la créativité, et la sensibilité émotionnelle nécessaires pour créer des contenus qui résonnent profondément avec le public. L’IA est un outil qui peut augmenter les capacités des créateurs de contenu, en leur permettant de se concentrer sur les aspects les plus créatifs et stratégiques de leur travail. |

| 2. L’IA ne peut pas créer de contenu original ou créatif Vrai ou Faux ? Faux. Explication : Les progrès récents dans le domaine de l’intelligence artificielle ont montré que l’IA peut générer des contenus originaux et créatifs, allant des articles de blog aux œuvres d’art. Cependant, l’originalité et la créativité de l’IA sont guidées par les données sur lesquelles elle a été entraînée, ce qui signifie que l’humain joue un rôle crucial dans la définition des directives et des limites de la création. |

| 3. Utiliser l’IA pour la création de contenu est éthiquement douteux Vrai ou Faux ? Cela dépend. Explication : L’utilisation de l’IA dans la création de contenu soulève des questions éthiques, notamment en ce qui concerne la transparence, le droit d’auteur, et la désinformation. Il est essentiel que les créateurs divulguent l’utilisation de l’IA et appliquent des pratiques responsables pour assurer que le contenu généré est éthique et fiable. |

| 4. Le contenu généré par l’IA est facilement identifiable et de qualité inférieure Vrai ou Faux ? Faux. Explication : La qualité du contenu généré par l’IA s’est considérablement améliorée, au point qu’il peut être difficile de distinguer le contenu créé par une IA de celui rédigé par un humain. Cela dit, la qualité peut varier en fonction de l’outil utilisé et de la spécificité de la tâche. Les meilleurs résultats sont souvent obtenus par une collaboration entre humains et IA, où l’IA fournit une base que les humains peuvent réviser et améliorer. |

| 5. L’IA peut comprendre et interpréter le contexte aussi bien qu’un humain Vrai ou Faux ? Faux. Explication : Malgré ses avancées, l’IA manque encore de la capacité à comprendre le contexte et les nuances de la communication humaine de la même manière qu’un humain. L’IA analyse les données basées sur des patterns et des statistiques sans véritable compréhension du contexte sous-jacent, ce qui peut conduire à des erreurs ou des malentendus dans le contenu généré. |